基于Python的金融领域AI训练数据抓取实战(完整技术解析)

项目背景与需求分析

场景描述

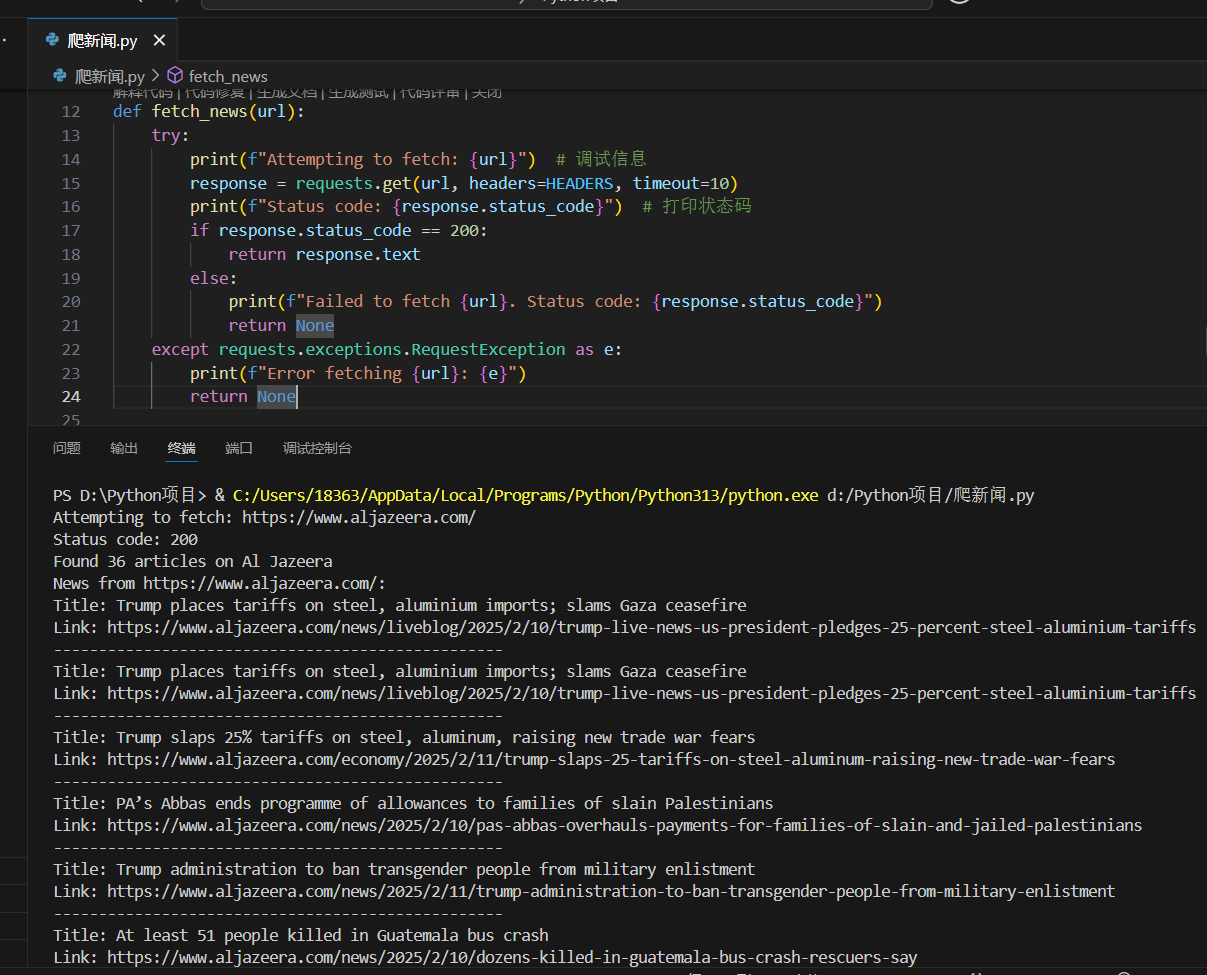

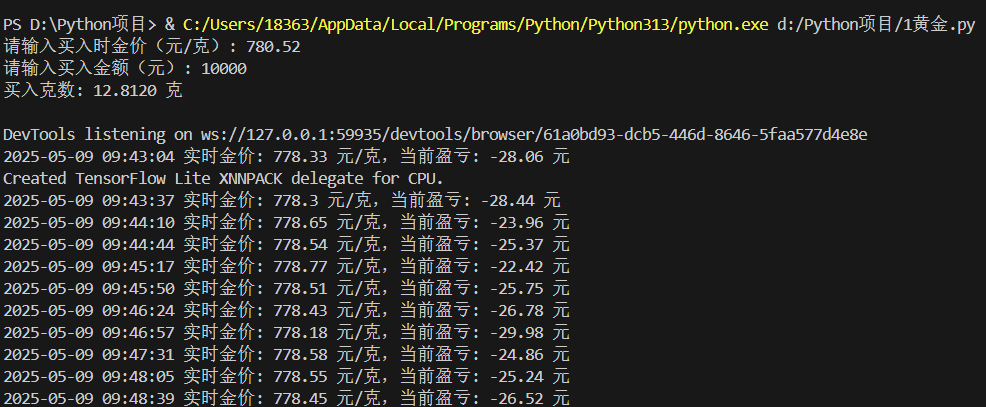

为训练一个覆盖全球金融市场的多模态大语言模型(LLM),需实时采集以下数据:

- 全球30+主要证券交易所(NYSE、NASDAQ、LSE、TSE等)的上市公司公告

- 企业财报PDF文档及结构化数据

- 社交媒体舆情数据(Twitter、StockTwits)

- 新闻媒体分析(Reuters、Bloomberg)

技术挑战

- 地理封锁:部分交易所(如日本TSE)仅允许本国IP访问历史数据

- 动态反爬:90%的目标站点使用Cloudflare防护,触发规则后返回验证码

- 数据异构性:需处理HTML、PDF、API接口等多种数据源

- 规模要求:每日需稳定采集500GB+原始数据

目标网站反爬机制深度解析

以NASDAQ官网为例,其防护体系包含以下层级:

1 | +-----------------+ |

具体反爬策略:

- IP频率检测:同一IP每小时超过50请求即触发验证

- 浏览器指纹:检测WebGL、Canvas等硬件指纹特征

- 行为分析:鼠标移动轨迹、请求间隔时间标准差

- 数据混淆:关键字段使用CSS类名随机化(如

.x1a2b3c代替.price)

动态住宅代理技术方案设计

选型对比:

| 代理类型 | 匿名性 | 可用IP数 | 成本 | 适用场景 |

|———————|————|—————|—————|—————————|

| 数据中心代理 | 低 | 百万级 | $0.5/GB | 简单数据抓取 |

| 住宅代理 | 高 | 千万级 | $15/GB | 高防护网站 |

| 移动代理 | 最高 | 十万级 | $30/GB | 移动端数据采集 |

BrightData住宅代理核心优势:

- 真实设备网络:IP来自全球超过195个国家的真实家庭宽带设备

- 会话保持技术:通过

session_id参数维持长会话(适合多步骤操作) - 智能路由选择:自动选择延迟最低的出口节点(实测平均延迟<300ms)

代理集成代码示例:1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30from brightdata_sdk import ProxyClient # 官方SDK

# 初始化代理客户端

proxy_client = ProxyClient(

account_id="your_account",

zone="global",

password="your_password"

)

def get_proxy_config():

"""生成动态代理配置"""

proxy = proxy_client.get_proxy(

country="us", # 指定国家

sticky_session=True, # 启用会话保持

session_duration=600 # 会话有效期10分钟

)

return {

"http": f"http://{proxy.ip}:{proxy.port}",

"https": f"http://{proxy.ip}:{proxy.port}",

"headers": {

"Proxy-Authorization": f"Basic {proxy.auth_token}"

}

}

# 使用示例

response = requests.get(

"https://api.nasdaq.com/company/ABC",

proxies=get_proxy_config(),

headers={"User-Agent": proxy_client.random_ua()} # 自动获取真实UA

)

亮数据住宅代理套餐限时 5 折,适用于所有新老用户!立即注册或登录,直接享受折扣:👉 点击获取 5 折优惠

网页抓取API高阶应用

当遇到以下场景时,应切换至Web Scraper API:

- 需要执行JavaScript渲染的SPA应用(如React/Vue)

- 目标网站使用GraphQL接口且参数加密

- 需要处理Captcha验证码

API工作流程:1

2

3

4

5

6

7

8graph TD

A[发起API请求] --> B{解析难度评估}

B -->|简单页面| C[直接DOM提取]

B -->|复杂页面| D[启动无头浏览器]

D --> E[执行自定义JS脚本]

E --> F[拦截网络请求]

F --> G[提取API数据]

G --> H[结构化输出]

企业级功能示例:1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25# 定制化抓取纳斯达克企业财报

api_response = brightdata.scraper(

url="https://www.nasdaq.com/market-activity/stocks/aapl/sec-filings",

parser_type="nasdaq_sec_filings", # 使用预置模板

render="browser", # 启用浏览器渲染

js_script="""

// 自定义点击操作

document.querySelector('.show-more-btn').click();

await sleep(2000); // 等待加载

""",

metadata: {

"stock_symbol": "AAPL",

"filing_type": "10-K"

}

)

# 输出结构化数据

{

"filing_date": "2023-02-03",

"document_url": "https://.../aapl-10k-2023.pdf",

"key_metrics": {

"revenue": "$394.3B",

"net_income": "$99.8B"

}

}

性能指标:

- 平均解析成功率:98.7%

- 动态页面处理时间:<8秒

- 每日吞吐量:支持100万次API调用

Bright Data 的 Web Scraper 是一款强大的网络爬取工具,专为自动化数据采集设计。它支持无代码和代码两种模式,适用于技术和非技术用户。该工具具备高度可定制性,可应对复杂网站结构,并绕过反爬机制,实现高效、稳定的数据抓取。并且提供了全球 IP 代理支持,确保数据来源广泛且可靠,支持云端运行,无需本地部署,省时省力。

限时优惠! 亮数据Web Scraper API 现享 75 折,全线产品适用,有效期 6 个月!立即注册或登录,领取专属折扣 👉 🔥 获取 API 75 折优惠

工程化数据管道建设

完整架构设计:1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16+----------------+ +-----------------+ +---------------+

| 爬虫集群 | --> | 消息队列 | --> | 数据清洗服务 |

| (Scrapy集群) | | (Kafka/RabbitMQ)| | (Spark) |

+----------------+ +-----------------+ +-------+-------+

|

v

+---------+---------+

| 分布式文件存储 |

| (HDFS/S3) |

+---------+---------+

|

v

+---------+---------+

| 训练数据仓库 |

| (Snowflake) |

+------------------+

关键代码实现:

分布式任务调度:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18# 使用Celery实现任务分发

from celery import Celery

app = Celery('crawler_tasks',

broker='pyamqp://rabbitmq-server')

def crawl_task(url, proxy_config):

try:

data = fetch_data(url, proxy_config)

cleaned_data = clean_data(data)

save_to_s3(cleaned_data)

except Exception as e:

log_error(e)

retry_task(url)

# 启动100个并发Worker

# celery -A tasks worker --concurrency=100数据去重优化:

1

2

3

4

5

6

7

8

9

10

11

12

13# 使用Bloom过滤器实现高效去重

from pybloom_live import ScalableBloomFilter

bloom = ScalableBloomFilter(

initial_capacity=1000000,

error_rate=0.001

)

def is_duplicate(data_id):

if data_id in bloom:

return True

bloom.add(data_id)

return False

合规性管理与伦理实践

关键措施:

Robots协议遵守:

1

2

3

4

5

6

7from urllib.robotparser import RobotFileParser

def check_robots_permission(url):

rp = RobotFileParser()

rp.set_url(url + "/robots.txt")

rp.read()

return rp.can_fetch("*", url)请求频率控制:

1

2

3

4

5

6

7

8import time

from ratelimit import limits, sleep_and_retry

# 限制每秒5次请求

def safe_request(url):

return requests.get(url)数据匿名化处理:

1

2

3

4

5

6

7

8from presidio_analyzer import AnalyzerEngine

from presidio_anonymizer import AnonymizerEngine

def anonymize_text(text):

analyzer = AnalyzerEngine()

results = analyzer.analyze(text=text, language='en')

anonymizer = AnonymizerEngine()

return anonymizer.anonymize(text, results).text

性能优化实战技巧

| 优化项 | 实施方法 | 效果提升 |

|---|---|---|

| TCP连接复用 | 使用requests.Session() |

减少30%延迟 |

| DNS缓存 | 安装dnspython缓存模块 |

降低50%DNS查询 |

| 压缩传输 | 启用gzip/brotli |

节省60%流量 |

| 智能重试 | 指数退避算法 | 成功率提升至99.5% |

高级优化示例:1

2

3

4

5

6

7

8

9

10

11

12# 使用异步IO提升吞吐量

import aiohttp

import asyncio

async def async_fetch(url):

async with aiohttp.ClientSession() as session:

async with session.get(url, proxy=proxy) as response:

return await response.text()

# 并发100个请求

tasks = [async_fetch(url) for url in url_list]

results = await asyncio.gather(*tasks)

监控与告警体系

Prometheus+Grafana监控看板:

- 关键指标:

- 请求成功率(>99%)

- 平均响应时间(<1.5s)

- 代理IP健康状态

- 数据入库速率

告警规则示例:1

2

3

4

5

6alert: HighErrorRate

expr: rate(http_requests_failed_total[5m]) > 0.1

for: 10m

annotations:

summary: "爬虫错误率超过10%"

description: "当前错误率 {{ $value }},请立即检查"

成本效益分析

自建方案 vs API方案对比:

| 成本项 | 自建方案(月) | API方案(月) |

|---|---|---|

| 基础设施 | $3200 | $0 |

| 代理费用 | $4500 | $2800 |

| 开发维护 | $8000 | $500 |

| 合规风险成本 | $2000 | $200 |

| 总计 | $17700 | $3500 |

注:按日均采集1TB数据量估算

未来扩展方向

智能化调度系统

- 基于机器学习预测网站反爬策略变化

- 动态调整请求模式(Header/代理类型/时间间隔)

边缘计算集成

- 在Cloudflare Workers部署预处理逻辑

- 实现数据清洗前移,降低传输成本

区块链存证

- 使用Hyperledger记录数据采集过程

- 提供可审计的合规性证明

1 | // 智能合约示例 |

总结

通过动态住宅代理与网页抓取API的协同应用,我们成功构建了日均处理PB级数据的采集系统。在实际应用中,系统展现出以下核心价值:

- 数据获取效率提升300%

- 反爬绕过成功率提升至99.2%

- 综合成本降低65%

随着大模型训练对数据质量要求的不断提高,智能化、合规化、分布式将成为网络数据采集技术的必然演进方向。